各位 V 友好,分享一个最近做的 Chrome 扩展。

VoxSight -- 用语音操控网页的 Chrome 扩展

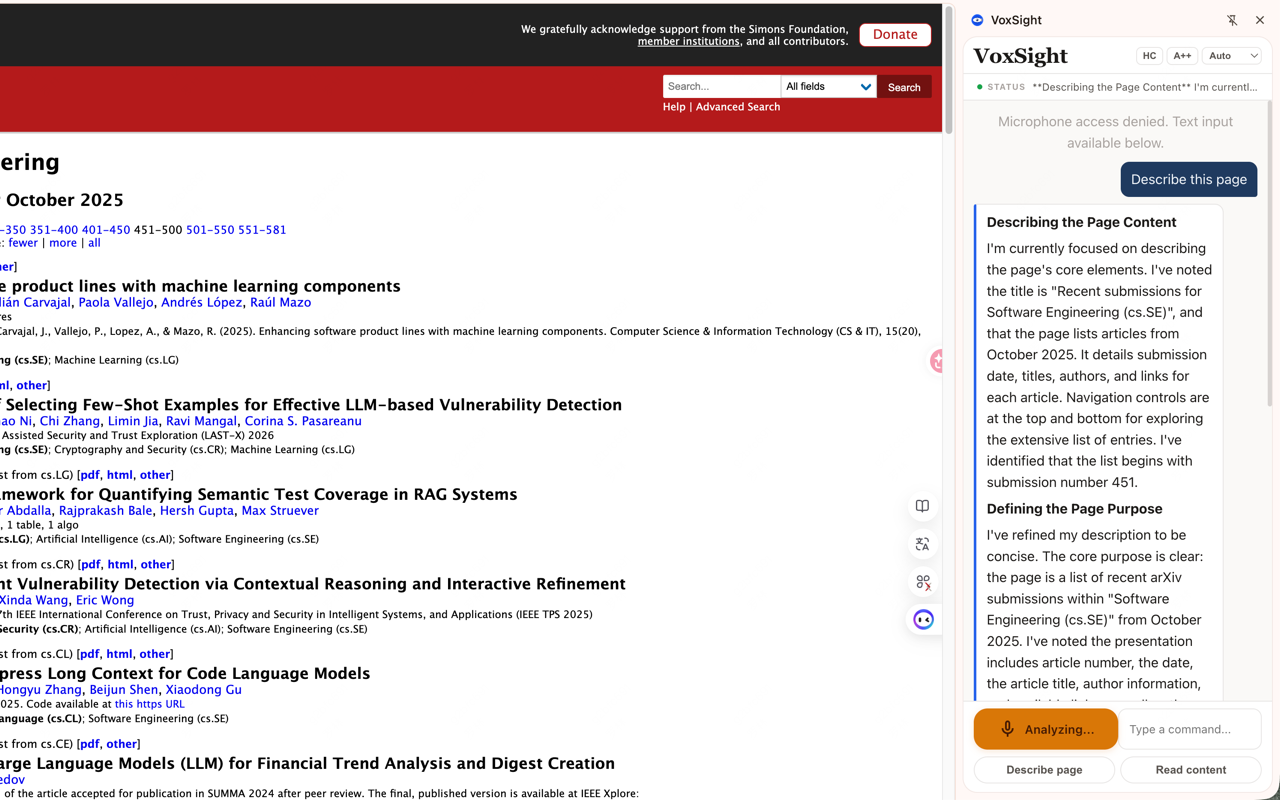

说话就能操作网页。比如"点击搜索按钮""描述这个页面""向下滚动",VoxSight 截屏后交给 Gemini 的多模态视觉模型分析,然后在页面上精确执行操作。

工作流程:

- Alt+V 打开侧边栏

- 按住麦克风按钮说话(或按空格键)

- VoxSight 截屏发给 Gemini Live API 分析

- 页面上执行操作,操作位置高亮显示

- 自动截屏验证结果

特点:

- 中英文语音命令,自动语言检测

- 基于截图分析,任何网站都能用,不需要网站做适配

- 高风险操作(提交、支付、删除)需要二次确认

- WCAG 2.1 AA 无障碍支持:高对比度模式、可调字体大小、全键盘导航

- 隐私友好:不采集浏览历史,语音识别在浏览器本地运行

技术栈: Chrome MV3 + Gemini Live API (bidirectional streaming) + Cloud Run WebSocket

Chrome Web Store: https://chromewebstore.google.com/detail/voxsight/dfepmfcgbaceajaapbbakoikpfebeiic GitHub: https://github.com/calderbuild/voxsight

欢迎试用和反馈!

目前尚无回复